Facebook hace malabares para frenar los bulos antes del 26-M

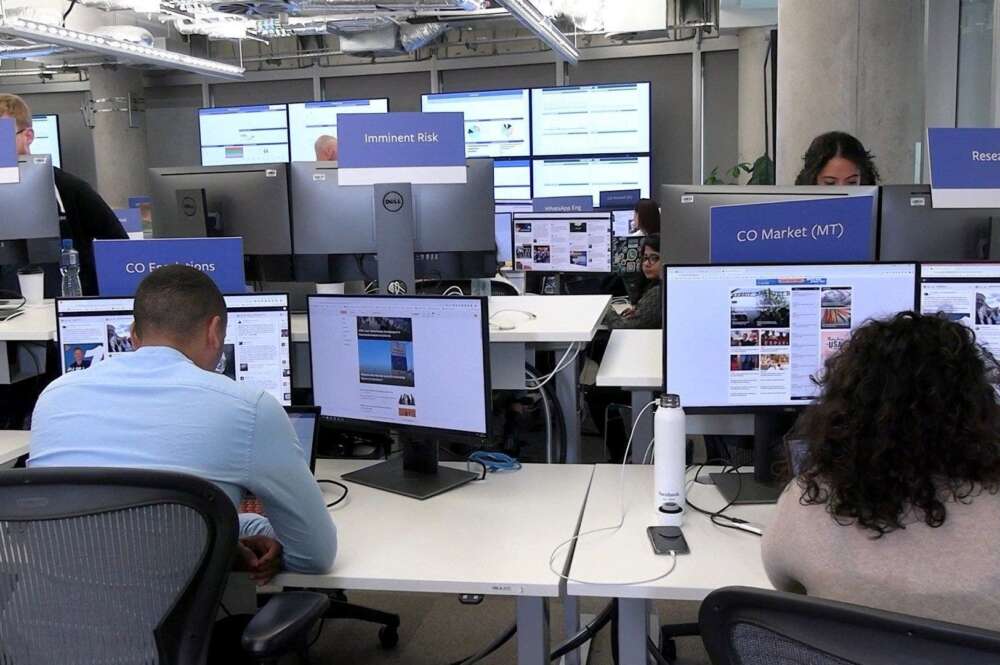

Facebook vigila desde su "sala de guerra" en Dublín el contenido político antes de las elecciones europeas como parte de su lucha contra las 'fake news'

De la misma forma que lo ha hecho en los principales procesos electorales de los últimos años, Facebook ha izado una suerte de «sala de guerra» en su sede europea en Irlanda para intentar mitigar las fake news y la desinformación antes de las elecciones al Parlamento Europeo, el próximo 26 de mayo. Un equipo de 40 personas combate las mentiras desde Dublín.

La tecnológica –que hace tres años restaba valor a las acusaciones de que su sistema lubrica la desinformación–, más que detener el despliegue de las fake news en tiempos electorales, quiere que el mundo vea que al menos se esfuerza para mantener algún control sobre su red social principal. No obstante, la información falsa igualmente se abre paso todos los días en el portal.

Grupos de extrema derecha como Alternativa para Alemania (AfD) y Agrupación Nacional (Francia) todavía dominan la discusión política en Facebook antes de los comicios, informó Politico. Además, España no es la excepción: antes del 28-A, la plataforma censuró a grupos de extrema derecha que enviaban mensajes a casi 2 millones de electores.

Facebook contra las ‘fake news’, una cuestión de supervivencia

Una de las críticas más fuertes hacia Facebook es que estos casos de contenido extremista han sido destapados por terceros, usualmente por medios de comunicación. Es decir, que pese a la inversión en personal y equipos para poner fin a la epidemia de las fake news, en muchos casos Facebook sigue siendo incapaz de detectar el problema de primera mano.

Al menos, Facebook ya no niega que lamentablemente es un trampolín para las mentiras y los contenidos tergiversados con fines políticos. Ahora asume el problema como propio, pero también admite que para dar la batalla de la mejor manera es necesaria la colaboración con actores externos y el trabajo de investigación que realizan muchos periodistas alrededor del mundo.

The Guardian afirma que combatir las fake news es un asunto de supervivencia corporativa para Facebook, que quiere que tanto los usuarios como los reguladores sepan que no se está quedando de brazos cruzados mientras algunos agentes llenan su red social de falsedades. La «cuarto de guerra» de Dublín es parte de ese plan.

El equipo europeo contra las fake news tiene en sus filas a hablantes nativos de las 24 lenguas oficiales de la Unión Europea. Además, son moderadores de contenido y se pasan el día navegando la plataforma para encontrar signos de manipulación, mentiras u odio. También cuentan con el apoyo de los ingenieros e investigadores de Facebook en todo el mundo.

Pero la empresa de Mark Zuckberberg no asume el rol con una sonrisa. «No creemos que sea lo indicado para nosotros convertirnos en reguladores de las campañas políticas», admitió el jefe del lobby de Facebook en la UE, Richard Allan. El alcance global de Facebook y su impacto en la sociedad obligan a la compañía a tomar medidas que no imaginaba.

¿Qué contenido elimina Facebook?

«Sabemos que algunos piensan que deberíamos eliminar todo el contenido de extrema derecha, pero tenemos preocupaciones sobre borrar todo durante un proceso electoral», dijo Allan. Facebook activó el concepto de «sala de guerra» para las últimas elecciones en EE UU, en noviembre de 2018, y la encargada de ese proyecto, Lexi Sturdy, ahora dirige el del 26-M en Dublín.

Pero la empresa no dice cuánto contenido revisa diariamente; solo habla de «cientos de incidentes» en la última semana. Algunos de los asuntos que vigila son la desinformación, los anuncios que invitan a no votar y los discursos de odio. La tecnológica asegura que, por ejemplo, en EE UU sus sistemas automáticos eliminaron el 90% de las publicaciones sobre no votar.

Esto quiere decir que solo el 10% de este tipo de publicaciones se eliminaron gracias a las quejas de los usuarios, pero no quiere decir que los sistemas de Facebook eliminaran todo el contenido similar. Eliminaron el que encontraron, pero todavía no hay ninguna máquina que encuentre todos y cada uno de los posts problemáticos en procesos electorales.