Así afecta a todas las empresas la regulación del algoritmo de la ley ‘riders’

El cambio en el Estatuto de los Trabajadores obliga a todas las empresas, y no solo a las plataformas digitales, a informar sobre sus algoritmos a los representantes sindicales

Un ‘rider’, frente a la Delegación del Gobierno en Cataluña (Barcelona), para protestar por la regulación del sector que prepara Yolanda Díaz / ED

España ya tiene ley de riders. La aprobó el Consejo de Ministros de esta semana y ya se ha publicado en el Boletín Oficial del Estado.

Se trata de una disposición adicional al Estatuto de los Trabajadores que, entre otras cosas, obligará a las empresas a informar a los representantes de los trabajadores de «los parámetros, reglas e instrucciones en los que se basan los algoritmos o sistemas de inteligencia artificial» que afecten «a la toma de decisiones que pueden incidir en las condiciones de trabajo», o «el acceso y mantenimiento del empleo».

Con ello, el nuevo Estatuto de los Trabajadores va mucho más allá de regular las condiciones de los riders autónomos de plataformas digitales como Glovo o Deliveroo.

De facto, reconoce el derecho de los comités de empresa —o de otras fórmulas de representación de las plantillas— a conocer no solo si existen dichos algoritmos, sino en qué parámetros se basan, matiza el profesor en Derecho del Trabajo Adrián Todolí en un artículo publicado en su blog. «Esta es la parte verdaderamente novedosa».

Todolí detalla en su publicación que, de esta manera, el Gobierno no ha esperado a que el Tribunal Supremo se haya pronunciado sobre esta cuestión —»adelantándose a la conflictividad»—. «La intangibilidad del algoritmo puede hacer imposible» que los trabajadores conozcan siquiera que existe, por eso la norma obliga a informar «no solo a los propios trabajadores», sino también a sus representantes.

Con Todolí coincide la experta Gemma Galdon, directora de Eticas, una consultora española especializada en la auditoría algorítmica. «Es muy emocionante ver a nuestro país liderar en regulación algorítmica, y especialmente en el mundo del trabajo. Ojalá más innovación regulatoria para proteger personas en procesos tecnológicos», opinaba esta semana en su perfil de Twitter.

Una batalla que empujan los sindicatos

El mundo del trabajo está cambiando. Años antes de que estallase la pandemia y buena parte del mundo adoptase el teletrabajo como una rutina más, varios dirigentes de empresas y especialistas vaticinaban un auge de lo que se viene a conocer como gig economy, y que se podría traducir como la economía de las pequeñas tareas.

La proliferación de plataformas digitales capaces de reunir a profesionales con empleadores para cumplimentar una serie de tareas a cobrar, gracias a sistemas de inteligencia artificial y apps y servicios que lo incentivan, podría acelerar ese proceso.

Precisamente por esa razón el de contar con algoritmos transparentes y éticos se torna imprescindible no solo en apps de reparto a domicilio, sino en cualquier empresa. Esto es lo que ha empujado al Gobierno a adoptar esta reforma del Estatuto de los Trabajadores que las propias centrales sindicales en España demandaban desde hacía meses.

Pepe Álvarez, secretario general de la UGT española, se refería a los clickworkers en un artículo publicado en su web en febrero de este mismo año, en el que llamaba a que «los algoritmos» no dominasen el trabajo. Por su parte, la UNI P&M, una confederación internacional de sindicatos, publicó hace unos meses una guía con recomendaciones a la hora de introducir los algoritmos en los centros de trabajo de la que se hacía eco CCOO.

En la propia guía, que puedes consultar aquí, una de las primeras reivindicaciones que la UNI P&M trasladaba a los sindicatos es que los trabajadores deben tener derecho «a conocer los instrumentos de gestión algorítmica que se utilizan y que les afectan», que estos algoritmos siempre deben tener «al ser humano al mando» y que su introducción en las dinámicas laborales debía realizarse de forma transparente y cuidadosa.

Otros gigantes también usan los algoritmos en el trabajo

En una app de reparto a domicilio, un algoritmo puede distribuir la carga de trabajo entre sus profesionales, así como premiar —o castigar— a un repartidor que no haya cumplido objetivos. Pero esta situación, que pretende regular la nueva ley de riders del Gobierno, no es la única.

Ya en 2019 Amazon fue duramente criticada después de que algunos sindicatos expresasen su preocupación ante la posibilidad de que un sistema de inteligencia artificial estuviese recomendando a qué trabajador despedir en función del rendimiento y la productividad que registraba de los mismos, algo que Amazon negó alegando que en el proceso siempre intermediaba un responsable.

La propia compañía del comercio electrónico volvía a ser objeto de polémica después de que un repartidor denunciase en Business Insider que había llegado a tener que orinar en botellas mientras hacía sus rutas para no demorarse en las entregas y evitar que el algoritmo que reparte las rutas le quitase puntos.

Más allá de las plataformas digitales

Los sindicatos en España son algunos de los agentes sociales que más han empujado este debate, hasta el punto de que, con la ley de riders aprobada, Glovo tomó la decisión de abandonar la CEOE para constituir su propia patronal. Entendía que la CEOE le había dado la espalda.

Pero los desafíos que ocasionan el uso de sistemas de inteligencia artificial en empresas y en centros de trabajo no son exclusivos de plataformas digitales como Glovo o Amazon o Uber, que también vio cómo en octubre del año pasado dos de sus conductores la demandaban para entender cómo funciona su algoritmo.

Esto también ocurre en consultoras e incluso en empresas más convencionales como aerolíneas, como reflejan dos noticias recientes. Por ejemplo, al igual que ocurre en España, las centrales sindicales en Reino Unido también están demandando reformas para evitar que sean los algoritmos los que decidan a quién se contrata y a quién se despide.

Lo exigía una organización llamada TUC tras publicar un informe en el que advertían que la regulación laboral británica estaba obsoleta para hacer frente a este desafío. Robin Allen, uno de los abogados que participó en la redacción del informe, destacaba en el Financial Times que «cada vez más empleadores están desistiendo de sus responsabilidades, ya que las asumen máquinas». «Cuando se sustituye a un jefe por un algoritmo, minas la relación personal entre empleadores y empleados».

Hace apenas una semana, medios lusos informaban de que la aerolínea participada por el Estado, TAP, estaba utilizando un algoritmo para despedir, y que se habían cometido errores: el sistema tecnológico no reconocía las ausencias por enfermedad como ausencias justificadas. Carlos Silva, líder de la UGT portuguesa, expresaba su preocupación en la TSF: «Es una noticia preocupante para el movimiento sindical y, por encima de todo, para la democracia». El algoritmo no tenía «corazón», denunciaba.

La ética algorítmica en el trabajo

La ley de riders no será el único acercamiento que hará el Gobierno de España para regular los desafíos de los algoritmos.

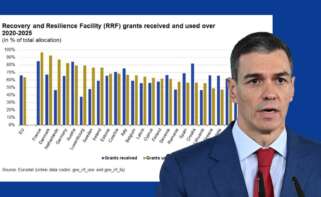

A nivel europeo, la Comisión ya ha presentado una propuesta de reglamento que determina que siempre hay riesgo e incluso prohíbe desarrollos tecnológicos en los escenarios más sensibles. En España, uno de los componentes del plan de recuperación que se regará con 72.000 millones de euros de los fondos europeos Next Generation estará destinado a la Estrategia Nacional de IA.

Una estrategia, sin embargo, que ya ha anunciado una propuesta de pliegos que a juicio de especialistas consultadas por Business Insider España puede tratarse de algo desfasada.

En un momento en el que el debate sobre la ética en algoritmos sigue creciendo, las tecnológicas como Amazon utilizaban estas tecnologías incluso para espiar a trabajadores que estuviesen planteándose sindicarse. Google acabó despidiendo a una de sus mayores expertas en ética algorítmica. La española Gemma Galdon explicaba por qué se estaban produciendo estos movimientos a priori antagónicos.

¿Malos tiempos para hablar de ética en IA? «No. Son buenos tiempos», aclara. «Todo esto sucede porque estamos ahora mismo en un proceso de transformación en el que se va a acordar qué significa ética, qué parte es legal y qué parte responde a la buena voluntad de las plataformas».

«Qué parte de la ética debe incorporarse para evitar que un producto no sea viable, porque pueda tener consecuencias sociales inaceptables». «O qué parte de la ética puede ser un valor añadido para las empresas. Hay bastante confusión», continuaba. «No es un mal momento, es parte del proceso».

«Cuando ya no eres capaz de sustentar esos compromisos con la equidad, la igualdad y la no discriminación porque luego no los cumples, la gente ve que hay un problema». En resumen: las palabras no bastan. Ha llegado la hora de pasar a la acción, según Galdon.

Noticia original: Business Insider

Autor: Alberto R. Aguiar